ATI

Die Firma ATI Technologies Ltd. mit Hauptsitz in Markham, Ontario/Kanada wurde 1985 gegründet. Das Hauptgeschäftsfeld ist die Herstellung von Grafikprozessoren. Diese werden für verschiedene PC-Architekturen wie auch Fernsehgeräte, Handys und andere hergestellt.

Weitere Vertretungen von ATI befinden sich in Barbados, Frankreich, Deutschland, Hong Kong, Irland, Japan, Malaysia, Großbritannien und den USA. Die Firma beschäftigt inzwischen etwa 1900 Mitarbeiter und erwirtschaftet einen Umsatz von ca. 1,3 Milliarde US-$

Nvidea

Die NVIDIA Corporation ist einer der größten Hersteller von Grafikprozessoren, Grafikkarten und Peripheriegeräten für PCs und Xbox. Der Hauptsitz liegt in Santa Clara, Californien. Der Umsatz stieg von 735 Millionen US-Dollar im Jahr 2000, auf 1,37 Milliarden US-Dollar in 2001.

Das Unternehmen wurde im Januar 1993 von Jen-Hsun Huang, Curtis Priem und Chris Malachowsky gegründet. Die Marke NVidia war bis 1997/98 relativ unbekannt, bis die Serie der RIVA PC-Grafikkarten herausgebracht wurde. Im Januar 1999 wurde NVidia in den Nasdaq aufgenommen und lieferte im selben Jahr die zehnmillionste Grafikkarte aus. Im Jahr 2000 kaufte das Unternehmen die Vermögenswerte von 3dfx auf, dem bis dahin größten Konkurrenten und größten Grafikkartenhersteller in der Mitte der 1990er. NVidia wurde als Zulieferer für die Grafikausrüstung von Microsofts Xbox ausgewählt. Im Februar 2002 waren bereits über 100 Millionen Grafikkarten ausgeliefert worden; NVidia beschäftigt weltweit ca. 1300 Mitarbeiter (Stand 2003).

[Quelle Nvidea.de ]

Die Geschichte von Grafikkarten

Das Grafikkarten-Prinzip wurde in Serienprodukten zum ersten Mal beim Mikrocomputer Apple II verwendet. ("80-Zeichen-Karte").

Der erste IBM PC kam 1981 mit einer Karte auf den Markt, die lediglich die Darstellung von Text ermöglichte. (MDA = Monochrome Display Adapter). Die Firma Hercules erkannte die Lücke und bot schon 1982 eine Karte an, mit der die Pixel des Textmodus einzeln angesteuert werden konnten, den HGC-Adpater.

Bis 1989 setzten sich die Grafikkartentypen als Standards durch, die IBM neu auf den Markt brachte:

- 1983 die CGA-Karte (mehr Informationen hier)

- 1984 die EGA-Karte (mehr Informationen hier)

- 1989 mit den s.g. PS/2-Modellen die MCGA- und VGA-Karte (mehr Informationen hier)

Ab da hatte IBM die Standardisierungsmacht verloren. Das ist der Hintergrund, warum auch heute noch der VGA-Modus (640 × 480 Punkte in 16 Farben) der "Notfall-Modus" bei allen PCs ist.

VGA war allerdings nicht der letzte Grafikkartenstandard. Die "Video Electronics Standards Asscociation" VESA stellte einen Standard für Videomodes bis zu einer Auflösung von 1280 × 960 Punkten in 2 Byte Farbtiefe auf, die heute jede Grafikkarte beherrscht.

Die weiteren Bezeichnungen SVGA, XGA usw. sind keine Grafikkartenstandards mehr, sondern Kurzbezeichnungen für Bildschirmauflösungen, z. B. XGA: 1024 × 768 Punkte.

Bis etwa 1990 beschränkten sich die Grafikkarten darauf, das Video-RAM in Ausgangssignale für den Monitor umzuwandeln. Der Programmierer konnte eigentlich nur einzelne Pixel setzen. Dies war die erste Generation der Grafikkarten. Es folgten zwei weitere:

- Die Windowsbeschleuniger

- Die 3D-Beschleuniger (mehr Informationen hier)

Ab 1990 entwickelten sich die Grafikkarten zu eigenständigen kleinen Computern mit eigener CPU (Windowsbeschleuniger), bei denen man nicht nur einzelne Pixel setzen konnte, sondern denen man Befehle zum Zeichnen von Linien und Füllen von Flächen schicken konnte.

Mitte der 90er-Jahre kam von 3dfx der erste 3D-Beschleuniger, die s.g. Vodoo-Karte. Einem 3D-Beschleuniger kann ein Programm in einem dreidimensionalen Raum die geometrischen Figuren in Form von Polygonen und die Texturen angeben, mit denen die Flächen der Polygone gefüllt werden sollen. (Rendern).

Im Jahr 2004 kann man drei Typen von Grafikkarten unterscheiden:

1. Onboard-Chips. Diese haben meist nur 2D-Funktionen, erlauben aber auf einem Monitor meist ein Bild hoher Qualität

(1600x1200 Pixel in 4 Byte Farbtiefe, s. g. 8 MB-Framebuffer). Solche Chips stammen meist von der Firma S3.

2. Karten für den Business-Bereich. Diese Karten haben maximal 32 MB Video-RAM, bieten 2D- und 3D-Funktionen an,

bieten einer sehr scharfes Bild auf dem Monitor und die Möglichkeit, mehrere Monitore gleichzeitig zu betreiben.

3. Karten für Computerspiele. Diese Grafikkarten gibt es in allen Preislagen. Die teuren Karten stellen das technisch Machbare im Bereich 3D-Darstellung dar.

Die neuesten Entwicklungen im Jahre 2004 sind hier mehrfache Vertex-Shader und Pixel-Shader, Mehrfach-Antialiasing und Transform and Lighting,

sowie Anisotropes Filtering (siehe Artikel "Anisotropes Filtern"). Hier konkurrieren hauptsächlich ATI und NVidia mit Chipsätzen,

die allerdings auf einer Vielzahl von Grafikkarten anderer Firmen verbaut werden. Eine gewisse Aussenseiterrolle nimmt Matrox mit der Parhelia-Karte ein.

Für die Darstellung von 3D-Computergrafik sind sowohl Business-Karten als auch Grafikkarten für Spiele geeignet.

Grafikkarten und Grafikschnittstellen Von den Grafikkarten zu unterscheiden sind Grafikschnittstellen, die bekanntesten davon OpenGL und DirectX, die es dem Programmierer ermöglichen, einfach und unabhängig von der Grafikkarte 3D-Effekte zu erzielen. Die Grafikschnittstellen setzen keine 3D-Funktionen bei der Grafikkarte voraus, nutzen diese aber (teilweise), falls sie vorhanden sind. 3D-Spiele können somit auch im Prinzip auf Computern mit Onboard-Grafik oder einer sehr einfachen 3D-Karte laufen, jedoch langsam und "ruckelig". Sehr aufwändige Spiele nutzen zusätzlich zur Grafikschnittstelle noch spezifische, neue Funktionen der Grafikkarte und laufen daher nur auf einer Karte mit speziellen Grafikchips.

Die zur Zeit bekanntesten Hersteller von Grafikprozessoren sind ATI, Matrox und NVidia.

Weitere Marken sind oder waren : 3dfx, Chips & Technologies, Cirrus Logic, Creative Labs / 3Dlabs, Diamond Multimedia, Elsa, Hercules Graphics, Intel, Number Nine, Oak Technology, Orchid Technologies, Paradise, SIS, S3, Trident (8900), Tseng Labs (ET4000), Video Logic und Video Seven.

Diese haben mehrheitlich bei der schnellen und aufwändigen Entwicklung von 2D und 3D-Beschleunigertechniken und der damit verbundenen Marktkonzentration ihre Konkurrenzfähigkeit und Bedeutung verloren oder sich in Nischenmärkte zurückgezogen.

Zitiert von der Seite wikipedia.de

Grafikkarten früher und heute :

- Früher

Die ersten Modelle von Grafikkarten waren ganz simple Geräte mit denen man nur das Bild das angezeigt werden sollte auf den Monitor bringen sollte. Sie waren groß und hatten kaum Speicher.

Dies ist eine eine alte Vodoo 2 aus dem Jahr 1996 :

- Heute

Mit den ersten neueren Grafikkarten wurde klar das sie zu mehr zu gebrauchen sind. Man merkte dass man mit ihnen mehr machen kann und so wurden die Grafikkarten stätig besser und mit mehr Funktionen ausgestattet. Eine dieser Grafikkarte war die Voodo reihe die mit 3 dfx zu kaufen war sie war einer der Vorreiter der heutigen Radeon 9800 oder Geforce FX 5900.

Wozu Grafikkarten benutzt werden :

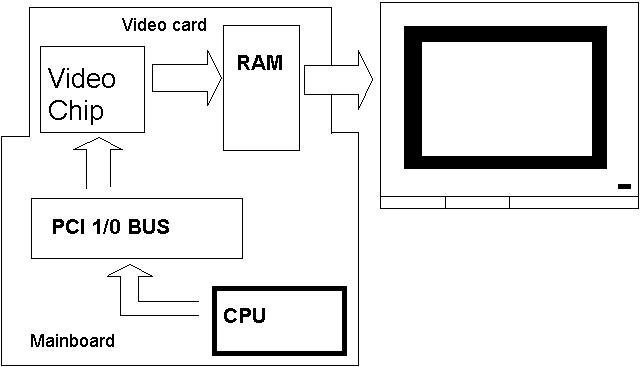

Die Haupteigenschaft einer Grafikkarte besteht darin die Informationen die ein Computer erzeugt auf den Monitor zu bringen. Sie wandelt die Daten die der Computer an die Grafikkarte schickt um, um es als ein Bild wieder auszugeben das für den Menschen zu erkennen ist.

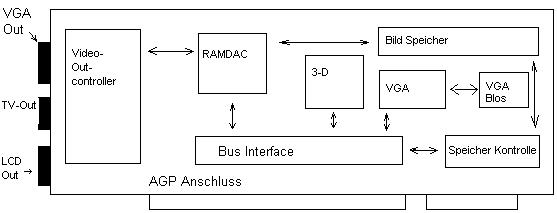

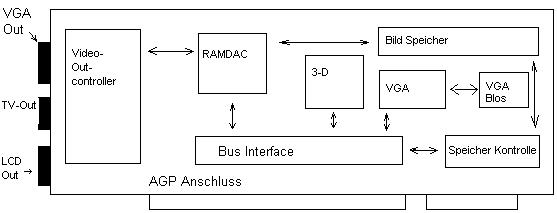

Aufbau einer Grafikkarte

Hier ist ein Bild wie die meisten neusten Grafikkarten aufgebaut sind.

Hier sind die Anschlüsse bei einer Geforce 5900 xt.(Die Anschlüsse sind mit den Anschlüssen der Radeon 9800 gleich.)

Auf der linken Seite ist der DIV 24-PIN Anschluss.

In der Mitte ist der S-Video Anschluss.

Und rechts ist der Monitor 15-pin Anschluss.

Was bedeutet AGP

Der Acclerated Graphics Port (AGP) ist ein Hochgeschwindigkeits-Bussystem, mit dem Computer-Peripherie mit dem Mainboard eines Computers verbunden werden kann. Sein Haupteinsatzzweck ist die Beschleunigung von 3D-Grafik.

AGP benutzt den normalen Arbeitsspeicher (RAM) des PCs, um dort das Monitorbild, Texturen, Z-Buffer-, Alpha Blending- und andere Grafikdaten zu hinterlegen. Der Acclerated Graphics Port stellt ein kohärentes Speichermanagement zur Verfügung, das ein schnelles Lesen von im Speicher verteilten Daten in schnellen "Bursts" ermöglicht. AGP reduziert durch die Benutzung von existierendem Systemspeicher die Kosten für High-End Grafiksysteme.

AGP wurde von Intel entwickelt, die den Bus 1998 erstmals in einen Chipsatz für ihren Pentium II-Prozessor einbauten. AGP-Karten sind etwas länger als PCI-Erweiterungskarten. Die Einrichtungen auf dem Mainboard bestehen im wesentlichen aus dem AGP-Steckplatz und der AGP-Bridge, die in der Northbridge des Chipsatzes untergebracht ist. Die Grafikkarte ist auf diese Weise auf dem schnellsten Wege mit der CPU und dem Arbeitsspeicher verbunden, die beide für die Grafikperformance von essentieller Bedeutung sind. Um auch Speicherzugriffe an der CPU vorbei zu ermöglichen (und so für Entlastung des Prozessors zu sorgen), bekommt der AGP vom System-BIOS exklusiv einen bestimmten Speicherbereich im RAM zugewiesen.

Die erste Version von AGP, AGP 1x, ist ein 32-bit Bus mit einer Taktrate von 66 MHz. Daraus ergibt sich eine maximale Transferrate von 266 Megabyte pro Sekunde. Ein normaler PCI-Bus (33 MHz) schafft im Vergleich genau die Hälfte, 133 MB/s.

Neuere Versionen des AGP steigerten die Transferrate u.a. mittels Double-Data-Rate-Verfahren ('DDR') um das zwei- bis achtfache. Entsprechend gibt es heute neben AGP 1x auch AGP 2x (533 MB/s), AGP 4x (1.066 MB/s) und AGP 8x (2.133 MB/s). Zusätzlich existieren noch sog. AGP Pro-Karten. Deren Kontaktleisten sind etwas länger als die normaler AGP-Karten. AGP Pro bedient Karten mit höheren Stromstärken, da insbesondere professionelle und semi-professionelle Grafiklösungen immer stromdurstiger werden.

AGP erlaubt auch die effizientere Nutzung des Frame Buffer-Speichers und hilft so auch bei der Beschleunigung von 2D-Grafik. Außerdem wird der AGP-Slot auch von einigen RAID-Controllern auf Grund seiner höheren Transferrate als Steckplatz anstelle von PCI benutzt, obwohl er eigentlich nicht dafür gebaut worden ist.

Mit der neuesten Version AGP 8x ist diese Technik zu Ende entwickelt, da sich auf Grund von Leckströmen, Timing-Problemen bei hohen Taktungen und dem zunehmend komplizierter werdenden Platinendesign die Geschwindigkeit nicht weiter steigern lässt. Ab etwa 2005 sollen neue Mainboards keine Unterstützung für AGP mehr haben, und stattdessen PCI-Express verwenden. Die ersten entsprechenden Chipsätze sollen zusammen mit Intels neuer CPU-Generation Tejas erscheinen. nVidia's derzeit in der Entwicklung befindliche NV40-GPU wird keine AGP-Unterstützung mehr haben, und ATI's kommende R420 GPU wird AGP nur über einen aufwändigen Konverter-Chip unterstützen.

Der RAM bei einer Grafikkarte :

Jede Grafikkarte benutzt einen eingebauten Speicher diesen nennt man RAM. Es gibt 2 wichtige Merkmale:

Heute gibt es bereits Grafikkarten mit 256 MB Ram daher ist es nun kein Problem mehr mit welcher Auflösung und mit wievielen Farben man an einem Computer arbeitet. Da genügend Speicher zur verfügung steht.

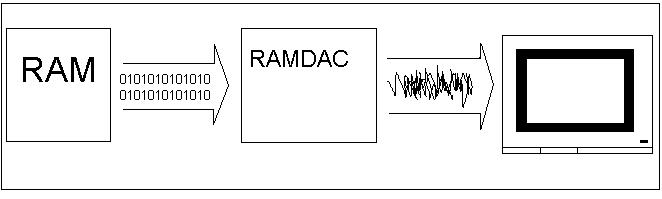

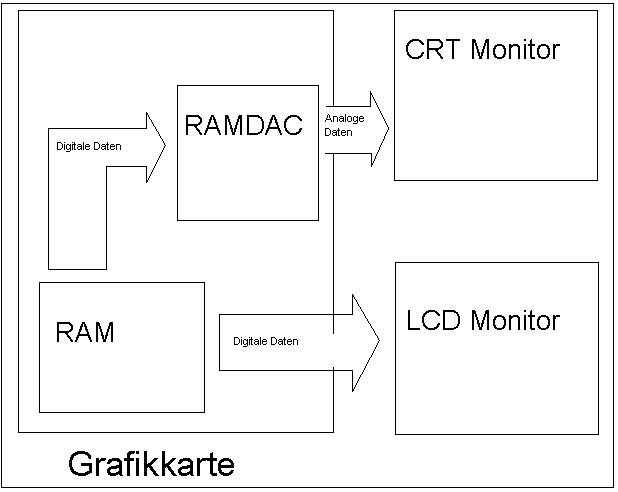

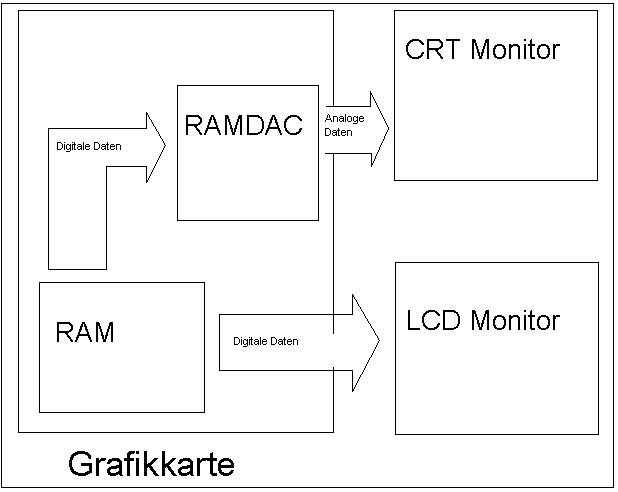

Der RAMDAC :

Der PC arbeitet mit digitalen Signalen, die an die Grafikkarte gesschickt werden. Monitore aber brauchen analoge Signale. Deshalb haben alle Grafikkarten einen RAMDAC-Chip der die digitalen Signale in analoge umwandelt:

Ein moderner Chip zeichnet 2 Punkte aus :

- Ein externer Chip, der nicht in der Grafikkarte eingebaut ist

- Taktfrequenz: 250 - 360 MHz.

Digitale Grafikkarten :

LCD-Monitore arbeiten mit rein digitalen Signalen. Grafikkarten wandeln die digitalen Signale in analoge um, die ein CRT-Monitor verarbeiten kann. Dabei entstehen aber Verzerrungen und Rauschen, was die Bildqualität mindert. Das gibt es bei einer digitalen Garfikkarte nicht, da der LCD-Bildschirm digitale Signale verarbeiten kann. Viele LCDs der ersten Generation hatten einen normalen analogen VGA-Anschluss mit fünf Signalen (rot, grün, blau, horiz. Sync., vert. Sync.), um kompatibel mit der bestehenden Hardware und billig zu sein. Man konnte sie an herkömmliche Grafikkarten anschliessen. Das Bild war dann aber nicht optimal. Da der LCD-Bildschirm digital arbeitet, sollte er auch mit einem digitalen Signal angesteuert werden. Die meisten heutigen LCD-Bildschirme werden mit einer zusätzlichen digitalen Grafikkarte verkauft. Die kostet zwar etwas, aber der LCD-Monitor wird dadurch billiger, da man hier keinen Analog-Digital-Converter (ADC) braucht. Die Zusatzkarten waren bisher herstellerspezifisch, aber das soll sich bald ändern. ATI hat eine Karte am Start (den Xpert LCD Adapter), die drei Funktionen enthält: Ein 15 pin-Standard-SVGA-Anschluss für CRT-Monitore Ein Anschluss für Fernsehgeräte Ein 20-pin-Anschluss für digitale Monitore

Diese Karte könnte zum de facto-Standard bei LCDs werden. Sie hat einen eingebauten RAMDAC, der für normale Monitore gebraucht wird:

Zitierter Text von der Seite

Treiber für eine Grafikkarte :

Treiber sind dazu da das die Grafikkarten immer einwandfrei funktionieren. Heute kann man sich die neusten von fast jeder Internetseite die etwas mit Computer zu tun hat herunterladen. Man braucht diese Treiber um z.b die Bildwiederholungsrate oder um einfach nur die Auflösung am Computer zu verstellen.

Geschichte der Computergrafik

Die Computergrafik nutzt zum einen die Mittel der Informatik zur Erzeugung und Erweiterung von Bildern (CGI - Computer Generated Images) und Animationen. Zum anderen bietet sie Methoden und Algorithmen an, um aus bestehenden Bildern verschiedenartige Informationen auszulesen.

Die Computergrafik findet ihre Anwendung mittlerweile in vielen Bereichen der (Unterhaltungs-)Industrie, der Wissenschaft und der Kunst, sei es in Computerspielen, Visualisierungen (z.B. Diagrammen), Entwicklung (z.B. CAD) oder Simulation und natürlich auch auf nahezu allen heutzutage verwendeten Personal Computern für die Bedienoberfläche, beispielsweise Microsoft Windows oder Apple MacOS.

Vom technischen Standpunkt aus betrachtet lässt sich der Bereich CGI weiter in die Bereiche 2D-Computergrafik und 3D-Computergrafik unterteilen.

Geschichte der Computergrafik:

ca.1950:Erste Nadeldrucker und Kathodenstrahlröhren-Bildschirme.

Anfang der 1950er: Erste Animation eines "springenden Balls" auf einem Oszilloskopen von Jay Forrester am MIT.

1961: Sketchpad. Ein Programm zum erstellen von Grafiken mit Lichtgriffel und Tastatur. Entstanden im Rahmen der Dissertation von Ivan Sutherland am MIT.

1973: Erste SIGGRAPH Tagung der ACM.

1976: Im Film Futureworld wird zum ersten Mal eine Computergrafik verwendet: Das animierte Drahtgittermodell einer Hand.

1980: Erste IBM und Apple Rechner mit grafischer Oberfläche. An den Bell Labs werden von Turner Whitted erste Raytracing-Verfahren entwickelt.

1981: IBM führt den CGA-Standard ein. Damit lassen 320x200 Pixel bei 4 Farben darstellen.

1982: Der Film Tron kommt in die amerikanischen Kinos, der erste Film in dem reine Computeranimationen verwendet werden. Gründung der Firma Silicon Graphics.

1984: Cindy Goral entwickelt das Radiosity Verfahren.

1986: Die Firma Pixar wird gegründet und wird im selben Jahr mit dem vollständig im Computer erzeugten Film Luxo Jr. für den Oscar für den besten animierten Kurzfilm nominiert.

1993: OpenGL trägt erheblich zur Standardisierung und damit der Verbreitung von 3D-Computergrafik bei.

Zitierter Text von der Seite wikipedia.de

Was ist 3-D Grafik :

3D-Computergrafik ist ein Oberbegriff für verschiedene Verfahren zur Darstellung räumlicher Daten mit den Mitteln der Computergrafik.

Die 3D-Computergrafik lässt sich in zahlreiche weitere Bereiche unterteilen:

Zum einen die photorealistische 3D-Computergrafik, die sich mit der möglichst detailgetreuen Nachbildung der Wirklichkeit befasst. Im Gegensatz dazu steht die nicht-photorealistische 3D-Computergrafik, die z.B. aus ästhetischen Gründen Verfremdungen erzeugt (z.B. Comic-Renderer). Am wichtigsten sind hier Raytracing und Radiosity, bzw. so genannte globale Illuminationsverfahren. Zwei weitere große Teilbereiche der 3D-Computergrafik stellen die Virtual Reality (Virtuelle Realität) und die Augmented Reality (Erweiterte Realität) dar. Beide legen ihr Hauptaugenmerk auf die Echtzeitfähigkeit und die sich daraus ergebende Interaktion mit dem Betrachter (z.B. verändern der Perspektive bei einer Drehung des Kopfes).Während in der Virtual Reality Welten komplett im Rechner generiert werden, beschäftigt sich die Augmented Reality mit dem Einbinden von künstlichen Objekten in die Realität (z.B. über Datenbrillen). Hier wird vor allem mit dem so g enannten Scanline Rendering gearbeitet. Noch eine wichtige Anwendung der 3D-Computergrafik ist die Modellierung von CAD-Volumenmodellen, die dann zum Beispiel auch für Festigkeitsberechnungen, ohne Zeichnungen direkt zur Fertigung oder im Fahrzeugbau für Crashsimulationen verwendet werden können. Aufgrund der drastisch gestiegenen Leistung von Grafikkarten in den letzten Jahren lassen sich immer hochwertigere Bilder in Echtzeit berechnen, dennoch unterscheiden sich die verwendeten Verfahren nachwievor erheblich. Wesentlich zur Entwicklung der Echtzeit 3D-Computergrafik hat der ursprünglich von Silicon Graphics eingeführte Grafikstandard OpenGL beigetragen, der die Möglichkeiten moderner Grafikhardware nutzt. Aktuell wird die Entwicklung, vor allem im Bereich der Computerspiele, auch stark durch das von Microsoft entwickelte DirectX vorangetrieben. Außer DirectX und OpenGL gab es noch andere Ansätze, wie zum Beispiel Glide. Diese konnten sich allerdings nicht durchsetzen. Im professionellen Bereich hat nur OpenGL wirkliche Bedeutung, da DirectX stark auf die Entwicklung von Spielen optimiert ist.

Verfahren

Die zentralen Verfahren der 3D-Computergrafik beschäftigen sich mit der Ausbreitung von Licht und dessen Reflexionen bzw. Transmission sowie der Darstellung auf einem zwei dimensionalen Ausgabegerät (Monitor). Aufgrund der Komplexität einer physikalisch korrekten Berechnung des Lichtaustauschs zwischen Gegenständen in einem Raum, sind alle Verfahren immer nur (grobe) Annährungen an die Realität. Es gibt daher auch eine große Anzahl verschiedener Beleuchtungsmodelle mit jeweils unterschiedlichen Vor- und Nachteilen bzw. Möglichkeiten.

- Scanline Rendering (mehr Informationen hier)

- Raytracing (mehr Informationen hier)

- Radiosity (mehr Informationen hiern)

- Monte-Carlo-Raytracing

- Photon-Mapping (mehr Informationen hier)

Ein weiterer wichtiger Aspekt der 3D-Computergrafik ist die Texturierung, das Einfügen von Bildern (oder berechneter Muster) auf Flächen im Raum.

Ebenfalls ein wichtiges Gebiet ist das Meshing, die Annährung einer mathematisch beschriebenen Oberfläche (z.B. einer Kugel) durch ebene Flächen.

Die 3D-Daten werden mit einem 3D-Modeller erstellt oder durch Messungen gewonnen. Um die Daten in darstellbare Bilder umzuwandeln müssen diese gerendert werden.

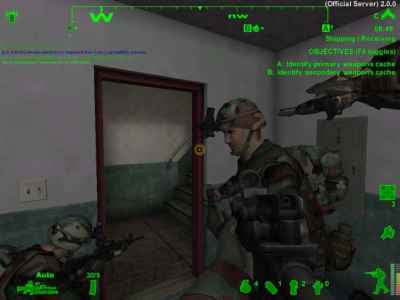

3-D Grafiken aus den Spielen Americas Army und FIFA:

Hier sind 2 gerenderte 3-D Grafiken:

In den letzten Jahren wurden einige 3D-Standards eingeführt. So zum Beispiel:

DirectX 3D:

DirectX ist eine Sammlung von APIs für Multimedia-Programme (vor allem Computerspiele) auf den Windows-Betriebssystemen (ab Win95) der Firma Microsoft. Neben dem PC findet DirectX auf der Spielekonsole Xbox Verwendung.

DirectX wird vor allem zur Darstellung komplexer 3D- und 2D-Grafik benutzt. Es bietet aber auch Unterstützung für Soundeffekte, Musik, diverse Eingabegeräte (z.B. Maus, Joysticks) und Netzwerkverbindungen für Multiplayerspiele.

Anstatt von DirectX sind für Windows-Systeme auch freie APIs verfügbar, die Teile von DirectX ersetzen, wie OpenGL für 3D-Grafik oder SDL für 2D-Grafik.

Aufbau von DirectX

DirectX besteht (in der aktuellen Version 9) aus folgenden Teilen:

DirectX Graphics

Unterstützung von 2D- und 3D-Grafik

Dies ist der am meisten genutzte Teil von DirectX. Er ermöglicht einen schnellen Direktzugriff auf die Grafikkarte.

Früher wurde zwischen 2D-Grafik (DirectDraw) und 3D-Grafik (Direct3D) unterschieden, die Weiterentwicklung von DirectDraw wurde jedoch eingestellt.

DirectSound

Zur Wiedergabe und Aufnahme von Soundeffekten, unterstützt Raumklang (dh Positionierung der Klänge im 3D-Raum)

DirectMusic

Für die Wiedergabe von Musik (MIDI-Musik, allerdings keine komprimierte Musik wie MP3)

DirectInput

Unterstützung von Eingabegeräten, wie Tastatur, Maus, Joysticks usw.

Ermöglicht Force-Feedback-Effekte (z.B. Rappeln eines Gamepads oder Widerstand beim Bewegen eines Joysticks)

DirectPlay

Für die Kommunikation von Multiplayerspielen untereinander, die auf verschiedenen Computern laufen (bei Netzwerkspielen oder Onlinespielen)

DirectShow

Für die Verarbeitung von Video- und Audio-Dateien.

Damit lässt sich verschiedenste Arten von Video-Dateien (AVI, MPEG) und Ton-Dateien (z.B. MP3) wiedergeben oder erstellen. Unterstützt auch Internetstreaming und ist durch sog. DirectShow-Filter beliebig erweiterbar.

DirectSetup

ermöglicht Programmierern, ihre Installationsroutine automatisch überprüfen zu lassen, ob die benötigte DirectX-Version bereits installiert ist und diese andernfalls zu installieren DirectX Media Objects

Bietet Möglichkeiten Audio- und Video-Ströme zu verändern.

Kann auch zusammen mit DirectSound und DirectShow verwendet werden.

Zur Funktionsweise

DirectX ermöglicht direkte Zugriffe auf die Hardware des Systems, ohne die Programme von der Hardware abhängig zu machen. So wird Spiele-Entwicklern eine Hardware-Abstraktions-Schicht (HAL von engl. hardware abstraction layer) für die Spieleprogrammierung zur Verfügung gestellt, mit der langsame Schnittstellen (z.B. Win GDI) umgangen werden..

OpenGL :

OpenGL ist eine Spezifikation für ein plattform- und programmiersprachenunabhängiges API (Application Programming Interface) zur Entwicklung von 3D-Computergrafik. Der OpenGL-Standard beschreibt etwa 250 Befehle, die die Berechnung komplexer 3D-Szenen in Echtzeit erlauben. Hersteller können jedoch auch eigene Erweiterungen definieren.

OpenGL ist nur ein Standard, keine Implementierung. Wie das Betriebssystem die Befehle verarbeitet, ist Sache des Grafikkarten-Treibers, der die Befehle an die Grafikkarte weitergibt (Hardware- oder auch Direct Rendering) oder auf der CPU ausführt, wenn die Grafikkarte den entsprechenden Befehl nicht bearbeiten kann (Software Rendering). Die Implementierungen werden daher in der Regel vom Hersteller zur Verfügung gestellt, es gibt jedoch auch Open Source Varianten wie z.B. die Mesa-Bibliothek.

OpenGL entstand ursprünglich aus dem von Silicon Graphics (SGI) entwickelten IRIS GL. Im so genannten Fahrenheit Projekt versuchten Microsoft und SGI ihre 3D-Standards zu vereinheitlichen, das Projekt wurde jedoch aufgrund finanzieller Schwierigkeiten auf Seiten von SGI abgebrochen.

Der OpenGL-Standard wird vom OpenGL Architecture Review Board (ARB) festgelegt. Das ARB exisitiert seit 1992 und besteht aus einer Reihe von Firmen wie 3Dlabs, Apple, ATI, Dell, Evans & Sutherland, Hewlett-Packard, IBM, Intel, Matrox, NVIDIA, SGI und Sun. Microsoft, eines der Gründungsmitglieder, hat das ARB im März 2003 verlassen. Neue Funktionen in OpenGL werden meist zuerst als Herstellerspezifische Erweiterungen eingeführt und gehen dann den Weg über Herstellerübergreifende Erweiterungen und ARB Erweiterungen zu Kernfunktionalität. Dies ermöglicht es, neueste Möglichkeiten der Graphikhardware nutzen und dennoch OpenGL abstrakt genug zu halten.

Aufgrund seiner Plattformunabhängigkeit ist OpenGL im professionellen Bereich als 3D-Standard nachwievor führend. Im Bereich der Computerspiele wurde es jedoch in den letzten Jahren zunehmend von Microsofts DirectX verdrängt und hält sich hauptsächlich noch aufgrund der Beliebtheit der Engines von id Software. Die aktuelle Version des Standards ist OpenGL 1.5.

Weitere bedeutende im Zusammenhang mit OpenGL stehende APIs sind:

- GLU, die OpenGL Utility Library, die vom ARB standardisiert und Teil jeder OpenGL Implementierung ist.

- GLX, die das Interface zwischen X und OpenGL bildet

- WGL, die Windows Graphics Library, die OpenGL und Windows verbindet und

- AGL, das entsprechende Gegenstück für MacOS.

- GLUT, eine Bibliothek, die aufbauend auf OpenGL, GLU und je nach Plattform GLX, WGL oder AGL eine plattformunabhängige API für Ein-/Ausgabe, Erstellen von Rendering-Kontexten und dergleichen mehr bietet.

- Java 3D, eine API für Java, welche es erlaubt, auf einfache Art und Weise 3D-Anwendungen zu entwickeln, die auf jedem Java-2-fähigen Betriebssystem laufen.

- OpenAL, eine Audiobibliothek für Raumklang, deren API an OpenGL angelehnt ist.

Verwendete Verfahren

- Scanline Rendering

- Shading

- Gouraud Shading

- Flat Shading

- Beleuchtungsmodell

- Phong Beleuchtungsmodell

- Rendering-Pipeline

Typische Anwendungen für OpenGL

- Virtual Reality

- Augmented Reality

- CAD

- Computerspiele

- VRML Authoring

- Bildschirmschoner

- Simulation

Zitiert von der Seite wikipedia.de

Antialiasing bei Grafikkarten

Grundlagen

Beim Antialiasing (Abkürzung: AA) durch Grafikkarten wird nicht nur einmal in der Mitte eines Pixel geprüft wird, welchen Farbwert dieser hat, sondern mehrmals und an verschiedenen Stellen ("mehrere Samples"). Man stelle sich beispielsweise vor, ein Pixel ist zu 60% von einer Fläche bedeckt. Diese Fläche berührt die Mitte des Pixels. Der Pixel erhält nun die Farbe der Fläche, obwohl sie ihn nicht zu 100% berührt. Um ein besseres Bild zu erzeugen, muß man einen mittleren Farbwert bilden, der sich zu 60% aus der Farbe der Fläche und zu 40% aus der Hintergrundfarbe bildet. Prüft man nun mehrmals innerhalb eines Pixels den Farbwert, kommt man dem optimalen Farbwert, mit steigender Anzahl der Samples (Prüfungen) pro Pixel, immer näher.

Verschiedene Methoden

In der Berechnung von 3-D Grafiken wird dieses Verfahren auch verwendet. Zunächst unterstützten nur sehr hochwertige und teure Grafikkarten diese Technik in Grafikschnittstellen wie OpenGL. Doch mit der Einfürung des Desktopgrafikchips VSA 100 von 3dfx, verwendet in den Grafikkarten Voodoo 4 4500, Voodoo 5 5500 und die nie offiziell erschienene Voodoo 5 6000, wurde dieses Feature auch für den normalen Anwender verfügbar. Bevor man auf das Anti-Aliasing einzelner Grafikkarten und Firmen eingeht sollte man die verschiedenen Techniken erklären:

Supersampling (SSAA): Supersampling ist eine Technik bei der man das Bild in einer höheren Auflösung berechnet und dann herunterrechnet, womit Farbmittelwerte entstehen. Z.B.: 4-faches AA. Das Bild wird in der Auflösung 800*600 angezeigt, aber in der 4-fachen Auflösung von 1600*1200 berechnet und dann auf 800*600 heruntergerechnet. Dadurch werden also indirekt 4 Samples pro Pixel berechnet. Dieses nennt man auch 2*2 Supersampling.

Der Vorteil dieser Technik ist, dass zumindest Ordered Grid (siehe unten) Supersampling nur per Treiber, d.h eigentlich mit jeder 3-D Grafikkarte, realisierbar ist. Außerdem werden nicht nur die Kanten geglättet sondern auch die Texturen (dies ist möglich da der Filter von Grafikkarten nicht perfekt ist, allerdings anisotropischer Filter kann bei neueren Grafikkarten aktiviert werden, der ein viel besseres Bild als der sonst übliche trilineare oder gar bilineare Filter bietet. Dieser Filter ist aber auch nicht ganz perfekt und kostet auch etwas Leistung.) Der Nachteil dieser Methode ist, dass sie sehr viel Leistung kostet.

Multisampling (SSAA): Bei dieser Technik werden nur die Farbwerte an den Kanten mehrmals überprüft und nicht die Texuren. Das kostet weniger Leistung, muss aber per Hardware untersützt werden.

Fragment Anti-Aliasing (FAA): Auch diese Technik glättet nur die Polygonkanten.(((Bitte noch Informationen ergänzen) Es ist aber möglich, dass nicht die Kanten an den Polygonenschnittkanten geglättet werden. Diese Technik kostet sehr wenig Leistung, muss aber auch per Hardware unterstützt werden.

OrderedGrid und RotatedGrid Anti-Aliasing (OGAA und RGAA): Bei OrderedGrid AA sind die Samples innerhalb des Pixels in geordneter Reihenfolge angeordnet, so wie der Anordnung von mehreren ganzen Pixeln auf einem Bild. (Z.B. wie bei dem angeführten Beispiel von Supersampling). Bei RotatedGrid sind die Samplepositionen gedreht (um eine bestimmte Gradzahl (z.B.: 27,5° beim VSA-100). Dies wirkt dem normalen Pixelmuster entgegen und erhöht so die interne Auflösung von innerhalb des Pixels, so dass ein qualitativ deutlich hochwertigeres AA entsteht. Beide Methoden sind bei allen 3 derzeitigen Techniken möglich. Bei Supersampling wird dies mit einer Verzerrung des Pixelmusters herbeigeführt.

Zitiert von der Seite wikipedia.de

Die neusten Grafikkarten :

ATI :

| Chip: |

ATI Radeon 9800 Pro |

| Chipdakt: |

380-MHz |

| RAMDAC |

400-Mhz |

| Steckplatz |

8x-AGP |

| Max. Auflösung |

2048 x 1536 (85 Hz) |

| Videospeicher |

256 Mb |

| Direct x |

Ja |

| Open GL |

Ja |

| TV-Ausgang |

Ja |

Nvidea :

Die verschiedenen Angebote:

GeForce FX 5950 Ultra

GeForce FX 5900 Ultra

GeForce FX 5900

GeForce FX 5900 XT

GeForce PCX 5950

Daten:

| Grafikprozessor: |

256-bit |

| Speicherschnittstelle: |

256-bit |

| Speicherbandbreite: |

30.4GB/s |

| Füllrate: |

3.8 Milliarden texels/s |

| Vertices/sec. |

356 Millionen |

| Memory Data Rate: |

950MHz |

| Pixels / Clock (max): |

8 |

| Textures / Pixel: |

16 |

| RAMDACs |

400MHz |

[Quelle: Nvidea.de ]

Vorschlag zum Kauf von einer Grafikkarte :

Beim Kauf einer Grafikkarte kommt es besonders darauf an was für einen Computer man besitzt. Wenn man einen Leistungsstarken Computer benutzt muss man auch seine Grafikkarte darauf abstimmen, denn wenn die Grafikkarte zu schwach ist also zu wenig leistung bringt kann dies den Computer erheblich langsamer machen. Aber wenn jetzt die Grafikkarte zu gut für den Rechner ist kann dies wiederrum den Computer einbremsen. Ebenfalls muss man auch noch darauf achten das meine seine Grafikkarte nach den bedürfnisse kauft nich einfach weil sie viel kostet sondern weil sie gute leistungen bei den Spielen bringt die man selber Spielen will. Den was bringt einem die beste Grafikkarte wenn dieses Spiel nich optimal darauf läuft. Heute Arbeiten ATI und Nvidea oft mit Spiele Herstellern zusammen um das beste Produkt zu bieten für die dazugehörige Grafik